安全測試流程總是碎片化?CyberStrikeAI 整合 100+ 工具的 7 個落地重點

CyberStrikeAI 真正值得看的,不是 100+ 工具,而是它把角色邊界、技能沉澱、漏洞狀態、攻擊鏈與稽核紀錄收進同一條作業鏈。這篇我不只整理 7 個落地重點,也拆出 5 個導入前該先問清楚的治理問題。

安全測試流程總是碎片化?CyberStrikeAI 整合 100+ 工具的 7 個落地重點

安全測試團隊最常見的瓶頸,很多時候不是工具不夠,而是工具很多、流程很散、證據難回放、結果不容易沉澱。掃描器有掃描器的報告,Burp 有 Burp 的流量,命令列工具有命令列工具的輸出,最後真正交付到團隊手上的,往往只剩一份難以追溯的結論。這也是我看 CyberStrikeAI 時最在意的一點:它真正想解的,不是「再包一層 AI 聊天介面」,而是把安全測試變成一條可運營、可協作、可稽核的作業鏈。

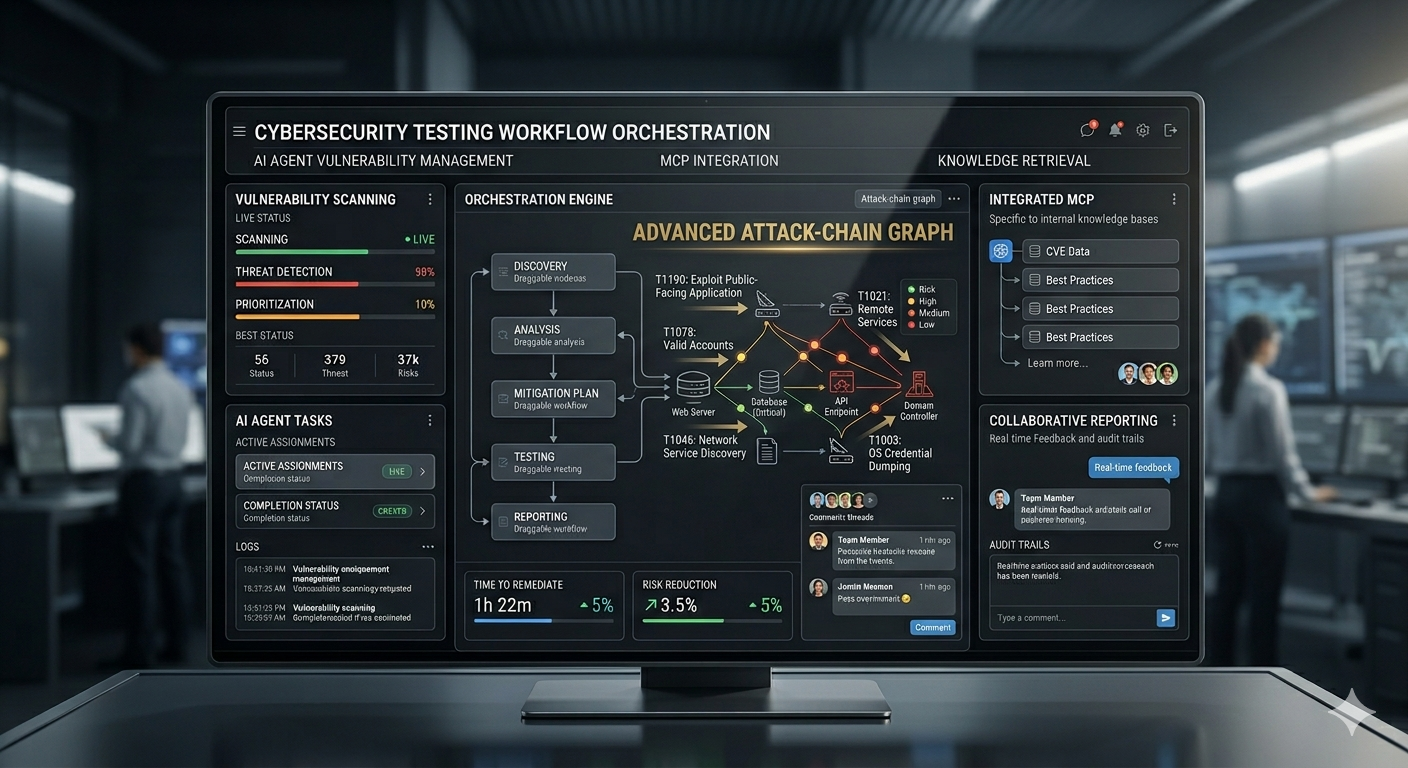

截至 2026 年 4 月 12 日,我查 GitHub API 時,CyberStrikeAI 有 3,269 stars、550 forks,主要以 Go 開發,採 Apache-2.0 授權。Repo README 把它定義成一個 AI-native security testing platform,整合 100+ 安全工具、角色系統、技能系統、漏洞生命週期管理、MCP 協議、知識庫檢索,以及 attack-chain graph。對我來說,這種定位比「AI 幫你跑工具」更值得注意,因為它碰到的是安全團隊真正卡住的管理問題。

一、先講我的結論:CyberStrikeAI 解的不是單點測試,而是安全作業的控制平面

如果你只把 CyberStrikeAI 理解成一個把 Nmap、Nuclei、SQLMap、Burp 等工具串起來的平台,那你會低估它。因為真正有價值的部分,不只是工具列表,而是它把對話、測試角色、技能、工具調度、漏洞紀錄、知識檢索、批次任務、WebShell 與攻擊鏈視圖放進同一套上下文裡。

這代表它想做的事,其實比較像「安全測試控制平面」。你不是單純問 AI 一句話,然後等它幫你跑工具;你是在一個帶有角色邊界、工具限制、知識檢索與結果追蹤能力的系統裡,讓測試過程變成一條有狀態的工作流。對流程已經碎片化的團隊來說,這比再多一個掃描器還有意義。

二、我認為最值得看的 7 個落地重點

1. 它把自然語言入口和可執行工作流綁在一起,而不是停在聊天層

README 明確寫到,CyberStrikeAI 的核心工作流是 conversation testing:自然語言需求會觸發工具鏈,並用 SSE 串流回傳過程。更重要的是,它不只有單一 ReAct 路徑,還能在啟用 multi_agent.enabled 後切換到 CloudWeGo Eino 的多代理模式,由主代理透過 task 調度短生命週期子代理。

這件事的落地價值在於,你不再只是問「幫我掃一下這個站」,而是可以把偵察、驗證、知識查詢、結果整理拆成不同執行段落。對安全團隊來說,這比較接近真正的工作方式。因為實務上,測試不是單輪問答,而是一連串帶有依賴關係的決策與動作。

2. 角色化測試不是裝飾,而是治理邊界

CyberStrikeAI 內建 12+ 種安全測試角色,像是 Penetration Testing、CTF、Web App Scanning、API Security Testing、Binary Analysis、Cloud Security Audit。更重要的是,角色不是 UI 上的分類標籤,而是能夠定義 user_prompt、限制 tools、附加 skills 的 YAML 配置。

這代表角色系統真正承擔的是治理功能。當你讓 AI 進入安全測試流程時,最大的風險從來不只是模型答錯,而是它拿到不該拿的工具、在錯誤情境下執行錯誤動作。角色化測試的意義,就是把能力邊界先寫死,再讓團隊在這個邊界裡運作。對想把 AI 引進紅隊、滲透測試或 API 安全流程的團隊來說,這比模型多聰明還關鍵。

3. Skills system 的真正價值,是把方法論沉澱成可重用資產

這個 repo 內建 20+ 安全測試技能,涵蓋 SQL injection、XSS、API security、cloud security、container security 等類型。技能不會自動全部灌進 prompt,而是作為角色提示或按需讀取內容,讓代理在需要時透過 read_skill 存取。

這是我特別看重的一點,因為很多安全 AI 平台最後都卡在同一個問題:每個人都能下 prompt,但沒有人真的在沉澱團隊方法論。技能系統的好處,是把「怎麼測、何時測、先看什麼、怎麼判斷」從個人經驗轉成可重用資產。當新人加入、當測試任務換手、當你要把一套方法複用到另一個 engagement,這種結構化技能比 prompt 範本更有長期價值。

4. MCP 與外部工具聯邦,讓它更像中控台而不是工具箱

CyberStrikeAI 不只支援內建工具配方,還有原生 MCP 能力,支援 HTTP、stdio、SSE 三種 transport,也支援外部 MCP federation。這表示它不是只會消耗自己 repo 裡的工具,而是可以把第三方 MCP server 納進來,作為測試流程的一部分。

如果你的安全團隊已經有既有工具鏈,這個設計非常重要。真正難的不是「有沒有工具」,而是「能不能把現有工具用同一個執行和審計框架收束起來」。README 甚至把 Burp Suite extension、外部 MCP、Web 模式與 stdio 模式都列得很清楚。這讓我對它的判斷不是「又一個 all-in-one 平台」,而是「一個試圖吸收既有工具資產的中控層」。

5. 漏洞生命週期與 attack-chain graph,補上了安全測試最常缺的一段

很多安全工具在發現漏洞那一刻就結束了,後面的分級、狀態流轉、統計、關聯性分析,通常要丟回別的系統處理。CyberStrikeAI 內建漏洞管理,支援 CRUD、severity、status workflow、statistics,還能把對話裡的目標、工具、漏洞與關係解析成 attack-chain graph,並提供 step replay。

這一層的價值很現實。因為安全測試在企業環境裡要成立,不只要能找到問題,還要能說清楚問題是怎麼來的、在哪個測試步驟出現、彼此之間有沒有鏈結、後續如何追蹤。當這些東西都能留在同一個平台裡,安全團隊和開發團隊之間的溝通成本會低很多。

6. 知識庫與檢索日誌,讓 AI 的判斷不只靠模型直覺

README 裡的 Knowledge Base 區塊其實很值得看。它不只是讓你丟 Markdown 進去做向量檢索,而是把 hybrid retrieval、auto-indexing、category 組織與 retrieval logs 都放進來。甚至還支援直接下載預建的 knowledge.db 做快速啟用。

這說明 CyberStrikeAI 並不是只把 LLM 當萬能腦,而是嘗試讓測試過程中的判斷依據可被管理。對安全場景來說,這非常重要。因為很多時候你不是要模型「想出答案」,而是要它在正確上下文中查到正確知識,再用可解釋的方式把結果連回測試流程。

7. SQLite 持久化、稽核與批次任務,讓它具備運營屬性

CyberStrikeAI 把歷史對話、工具呼叫、WebShell 連線、漏洞與群組資訊都放進 SQLite,並強調 replay、audit、batch queue 與狀態追蹤。批次任務支援 pending、running、completed、failed、cancelled;WebShell 模組則不只是一個 shell 視窗,還包含檔案管理、命令執行與與 AI 協作測試。

這意味著它不再只是「讓 AI 幫你跑一下」,而是開始具備安全運營平台的屬性。當一個平台開始處理歷史、任務狀態、證據重播、權限邊界與稽核需求時,你就不能再用單點工具的角度評估它,而要用平台治理的角度來看。

三、真正要導入前,我會先問這 5 個問題

1. 你的痛點到底是工具覆蓋不足,還是流程協作失控?

如果你的團隊只是缺少幾個掃描器或腳本,CyberStrikeAI 可能太重。但如果你真正卡住的是工具分散、證據不連續、漏洞難追蹤、知識難沉澱,那它就比較值得做 PoC。

2. 你能不能先把角色與工具治理寫清楚?

這種平台最怕的不是功能不夠,而是功能太強卻沒邊界。角色該用哪些工具、哪些流程允許 multi-agent、哪些外部 MCP 可以接入,這些都應該先定義,而不是上線後再補。

3. 你要先驗證哪一條高頻流程?

我不會建議一開始就全面導入。我會先挑一條高頻且容易量化的流程,例如 Web App 掃描、API 安全驗證、Burp 驗證流量回放,再看它是否真的縮短 triage 時間、提高證據完整度、降低人工整理成本。

4. 你有沒有能力處理「平台本身」的安全風險?

README 已經提醒有密碼保護、統一 auth middleware、timeout、sandbox guards,也提醒 MCP 暴露時要做網路層限制。這代表平台很強,但同時也意味著它自己就成了需要治理的安全系統。你必須用保護內部平台的標準來保護它,而不是把它當成普通測試工具。

5. 你能不能接受一個高速迭代中的產品?

截至 2026 年 4 月 9 日,最新 release 已到 v1.4.13,同一天前後也有 v1.4.12 等版本。這說明專案迭代速度很快。好處是問題修得快,像 Burp 插件可編輯指令與重複 reasoning persistence 問題都在近期被修掉;壞處是導入團隊要有能力跟上版本節奏,不能假設它已經是完全穩定的企業平台。

四、我的建議:把 CyberStrikeAI 當成安全流程 PoC,而不是單點工具替代品

如果你問我,這篇原本只寫「7 個重點」為什麼不夠,我的答案很簡單:因為 CyberStrikeAI 的價值不在功能數量,而在流程設計。你如果只列功能,讀者只會得到一個印象:這是一個很大的安全工具集合。但更準確的理解應該是:這是一個試圖把安全測試工作流平台化的系統。

所以我對它的建議不是「馬上導入」,而是「用一條高頻安全流程做 PoC」,驗證三件事:第一,AI 編排能不能真的縮短工作時間;第二,漏洞與攻擊鏈的沉澱能不能提升交付品質;第三,角色、技能與知識庫機制能不能讓團隊方法論被複用,而不是一直靠個人經驗撐住。

如果你的團隊現在最大的問題是流程碎片化,那 CyberStrikeAI 值得比一般「AI 安全工具」多看一輪。因為它碰到的是安全團隊真正難標準化的地方:上下文、治理、證據鏈與可重播的測試流程。